Deine robots.txt steuert längst nicht mehr nur Google und Bing. Im Jahr 2026 entscheidet diese kleine Textdatei auch darüber, ob KI-Crawler wie GPTBot, ClaudeBot und PerplexityBot deine Inhalte sehen – oder komplett ausgesperrt werden. Viele Website-Betreiber wissen nicht, dass ihre aktuelle Konfiguration entweder alles für KI-Training freigibt oder wichtige KI-Suchassistenten blockiert.

Die robots.txt basiert auf dem sogenannten Robots Exclusion Protocol, das Suchmaschinen-Bots (auch „robots“ genannt) durch Befehle wie „Disallow“ oder „Allow“ gezielt den Zugriff auf bestimmte Webseiten oder Ressourcen erlaubt oder verweigert, um beispielsweise sensible Daten oder spezielle Bereiche der Website vor Indexierung oder KI-Training zu schützen.

Dieser Artikel zeigt dir Schritt für Schritt, wie du prüfst, ob diese Bots Zugriff haben, und liefert dir ein einfaches Code-Beispiel für eine saubere robots.txt. Keine Programmierkenntnisse nötig – alle technischen Begriffe werden verständlich erklärt. Die meisten seriösen KI-Bots respektieren die robots.txt und halten sich an die darin festgelegten Regeln.

Kurze Einordnung: Was macht deine robots.txt mit KI-Crawlern?

Die robots.txt datei ist dein direkter Kommunikationskanal zu Suchmaschinen-Crawlern und KI-Bots. Sie teilt diesen Systemen mit, welche Bereiche deiner Webseite sie besuchen dürfen – und welche nicht.

Eine falsch konfigurierte txt datei kann zwei Probleme verursachen:

- Deine Inhalte werden ohne dein Wissen als Trainingsdaten für Large Language Models verwendet

- Wichtige KI-Assistenten wie Perplexity können deine Seite nicht indexieren und zeigen sie nicht in Antworten

Die bekanntesten KI-Crawler, die du kennen solltest:

Bot | Betreiber | Aktiv seit | Hauptzweck |

|---|---|---|---|

GPTBot | OpenAI | 2023 | ChatGPT & Training |

ClaudeBot | Anthropic | 2024 | Claude.ai |

PerplexityBot | Perplexity AI | 2024 | KI-Suchmaschine |

Grundlagen: Was ist eine robots.txt und wie wirkt sie auf KI-Crawler?

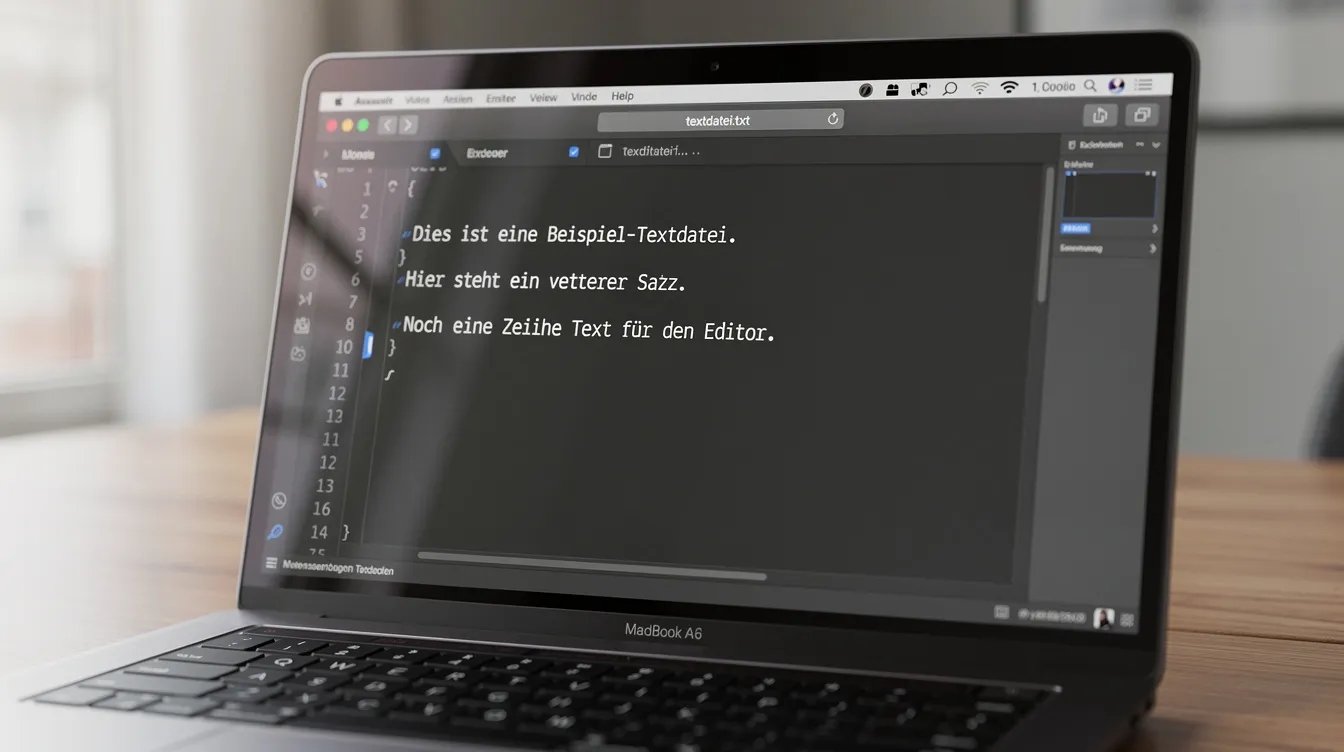

Die robots.txt ist eine einfache Textdatei, die im Stammverzeichnis deiner Website liegt. Du findest sie immer unter der Adresse deiner Domain mit /robots.txt am Ende.

Diese Datei enthält Crawling-Regeln für verschiedene Bots. Suchmaschinen Bots wie Googlebot und Bingbot lesen sie genauso wie KI Crawler von OpenAI oder Anthropic.

Die wichtigsten Begriffe in einer robots.txt:

- User-agent: Gibt an, für welchen Bot die folgenden Regeln gelten

- Disallow: Verbietet den Zugriff auf bestimmte Pfade oder Ordner

- Allow: Erlaubt explizit den Zugriff, auch wenn ein breiteres Verbot besteht

- Sitemap: Zeigt Crawlern, wo deine sitemap.xml liegt

Seriöse KI Unternehmen wie OpenAI und Anthropic respektieren diese Anweisungen. Allerdings ist die robots.txt kein rechtlich bindendes System – sie ist ein technisches Stoppschild, das gut programmierte Bots befolgen. Bösartige AI Data Scraper können sie ignorieren.

Wie KI-Crawler deine Inhalte nutzen

KI Systeme nutzen gecrawlte Daten auf verschiedene Arten:

- Trainings-Crawler sammeln Texte, Bilder und PDFs als Trainingsdaten für Sprachmodelle

- Such-Assistenten wie Perplexity rufen Informationen in Echtzeit ab, um Fragen zu beantworten

- Spezialisierte Crawler versorgen bestimmte KI Anwendungsfälle mit aktuellen Inhalten

ChatGPT verarbeitet täglich 2,5 Milliarden Anfragen. Das zeigt die Bedeutung dieser Systeme – und warum eine bewusste Steuerung per robots.txt so wichtig ist.

Zwischen 2023 und 2026 sind massenhaft Inhalte in LLM-Trainings eingeflossen. Viele Publisher haben das erst nachträglich bemerkt. Eine bewusste Konfiguration hilft dir zu entscheiden, welche Art der Nutzung du für deine Inhalte wünschst.

robots.txt konkret: Aufbau, wichtigste Befehle und ein einfaches Beispiel

Keine Sorge: Du brauchst keine Programmierkenntnisse. Die robots.txt ist reiner Text mit einfachen Regeln.

Die wichtigsten Direktiven im Überblick:

Direktive | Funktion | Beispiel |

|---|---|---|

User-agent | Ziel-Bot definieren | User-agent: GPTBot |

Disallow | Pfad verbieten | Disallow: /intern/ |

Allow | Pfad erlauben | Allow: /blog/ |

Sitemap | Sitemap verlinken | Sitemap: https://… |

Jede Subdomain (z.B. shop.deinedomain.de) braucht eine eigene robots.txt – die Regeln werden nicht automatisch vererbt.

Einfaches Beispiel: robots.txt mit KI-Crawler-Regeln

Hier ist ein Beispiel, das du direkt kopieren und an deine Domain anpassen kannst:

# Allgemeine Regeln für alle Crawler

User-agent: *

Allow: /

Disallow: /intern/

Disallow: /tmp/

Disallow: /login/

# GPTBot (OpenAI) - erlaubt, aber interne Bereiche gesperrt

User-agent: GPTBot

Allow: /

Disallow: /intern/

# ClaudeBot (Anthropic) - erlaubt, aber interne Bereiche gesperrt

User-agent: ClaudeBot

Allow: /

Disallow: /intern/

# PerplexityBot - erlaubt, aber interne Bereiche gesperrt

User-agent: PerplexityBot

Allow: /

Disallow: /intern/

# Sitemap für alle Crawler

Sitemap: https://www.deinedomain.de/sitemap.xmlUm einen Bot komplett auszusperren, ändere einfach die Zeile auf:

User-agent: GPTBot

Disallow: /Mit gptbot disallow / sperrst du den gesamten Zugriff. Gleiches gilt für perplexitybot disallow und ccbot disallow.

GPTBot, ClaudeBot & PerplexityBot: So prüfst du, ob sie blockiert sind

Warum solltest du das prüfen? Die Antwort hängt von deiner Strategie ab: Möchtest du maximale Sichtbarkeit in KI Suchen erreichen oder Premiuminhalte vor dem Training schützen?

Methode 1: Browser-Aufruf

Öffne in deinem Browser die Adresse: https://www.deinedomain.de/robots.txt

Die Datei wird als reiner Text angezeigt.

Methode 2: Suchfunktion nutzen

Drücke Strg+F (Windows) oder Cmd+F (Mac) und suche nacheinander nach:

- GPTBot

- ClaudeBot

- PerplexityBot

Methode 3: Regeln interpretieren

Findest du einen Eintrag wie diesen, ist der Bot blockiert:

User-agent: GPTBot

Disallow: /Findest du hingegen gptbot allow mit einem Pfad oder leerem Disallow, hat der Bot Zugriff.

Typische Szenarien: Unbewusst blockierte KI-Crawler erkennen

Fall 1: Komplette Blockade aller Bots

User-agent: *

Disallow: /Diese Konfiguration sperrt alle Crawler – auch GPTBot, ClaudeBot, PerplexityBot und sogar Googlebot. Das ist selten gewollt.

Fall 2: Alte SEO-Setups

Manche ältere Konfigurationen erlauben nur Googlebot explizit. Alle anderen Bots, einschließlich KI Crawlern, werden standardmäßig blockiert.

Fall 3: WordPress-Security-Plugins

Security-Plugins setzen manchmal aggressive robots.txt-Regeln. Prüfe, ob dein Plugin automatisch Einträge generiert hat.

Tipp: Sichere deine aktuelle robots.txt, bevor du Änderungen vornimmst. So kannst du jederzeit zurück.

KI-Crawler gezielt steuern: Beispiele für Allow- und Disallow-Strategien

Du musst nicht alles erlauben oder alles verbieten. Feinere Strategien sind möglich und oft sinnvoller.

Strategie 1: KI-Crawler komplett blockieren

Sinnvoll für Premium-Mitgliederbereiche, E-Learning-Plattformen oder vertrauliche Produkte. Du verhinderst, dass diese Bereiche als Trainingsdaten dienen.

Strategie 2: Nur öffentliche Inhalte zulassen

Erlaube den Zugriff auf Blog und Produkte, sperre aber /login/, /kundenbereich/ und /intern/. So schützt du sensible Daten, ohne auf Sichtbarkeit zu verzichten.

Strategie 3: Selektive Bot-Steuerung

Erlaube PerplexityBot für Traffic aus KI Antworten, blockiere aber GPTBot fürs KI Training. Diese Strategie trennt Sichtbarkeit von Trainingsnutzung.

Konkrete User-Agents: GPTBot, ClaudeBot, PerplexityBot

Hier die wichtigsten User Agent Namen für deine robots.txt:

- User agent GPTBot: Crawler von OpenAI für ChatGPT und Trainingsdaten

- ClaudeBot: Crawler von Anthropic für Claude.ai

- PerplexityBot: Crawler für die KI-Suchmaschine Perplexity

Die exakten Namen müssen genau so in der datei stehen. Groß- und Kleinschreibung ist wichtig.

Diese Namen können sich ändern oder erweitert werden. Es ist sinnvoll, mindestens jährlich zu prüfen, ob neue KI-Bots relevant geworden sind.

Hinweis: Google integriert KI-Funktionen über den klassischen Googlebot. Dieser ist nicht separat steuerbar – wenn du Googlebot erlaubst, gilt das auch für Googles KI-Features.

Rechtliche und ethische Aspekte: Darfst du KI-Crawler einfach aussperren?

Als Website Betreiber entscheidest du grundsätzlich, welche Bots du auf deiner Seite duldest. Die robots.txt ist das technische Mittel dafür.

Rechtliche Einordnung (keine Rechtsberatung):

- Datenschutz: Die DSGVO kann relevant sein, wenn personenbezogene Daten in gecrawlten Inhalten enthalten sind

- Urheberrecht: Deine Texte und Bilder sind geschützt – KI-Training kann eine Nutzung darstellen

Eine ausdrückliche Sperre per robots.txt dokumentiert deinen Schutzwillen. Ergänzend können Hinweise in den Nutzungsbedingungen sinnvoll sein.

Ethische Dimension:

Viele Betreiber möchten nicht, dass mühsam erstellte oder kostenpflichtige Inhalte ungefragt zu Trainingsdaten für kommerzielle KI Modellen werden. Das ist eine legitime Entscheidung.

Gleichzeitig kann eine bewusste Öffnung strategisch sinnvoll sein, wenn du maximale Sichtbarkeit in KI Antworten anstrebst. Die Chancen und Nachteile solltest du abwägen.

Grenzen der Kontrolle: Was robots.txt nicht leisten kann

Die robots.txt hat klare Grenzen:

- Bösartige Scraper können sie ignorieren – es gibt keinen technischen Zwang

- Der User Agent ist fälschbar – ein Bot kann sich als normaler Browser tarnen

- Bereits gecrawlte Daten bleiben in Trainingssets

Ergänzende Maßnahmen wie Firewalls, Rate-Limits und Bot-Management bieten zusätzlichen Schutz, gehen aber über den Scope dieses Artikels hinaus.

Trotz dieser Herausforderungen: Die robots.txt ist ein wichtiger erster Schritt. Seriöse Betreiber wie OpenAI und Anthropic respektieren sie. Nutze diese Basis-Kontrolle bewusst, statt beim Standard-Setup zu bleiben.

Best Practices für deine robots.txt im KI-Zeitalter

Empfehlungen für eine zeitgemäße robots.txt-Pflege:

- Regelmäßig prüfen: Mindestens 2–4 Mal pro Jahr, besonders nach Relaunches oder Plugin-Updates

- Sicherungskopie behalten: Speichere die funktionierende Version, bevor du Änderungen vornimmst

- Änderungen testen: Nach jeder Änderung robots.txt im Browser laden und mit Strg+F nach den Bot-Namen suchen

- Sitemap verlinken: Füge immer eine Sitemap-Zeile hinzu, um das Crawl Budget effizient zu steuern

Typische Fehler und wie du sie vermeidest

Fehler | Problem | Lösung |

|---|---|---|

Komplettblockade unter User-agent: * | Alle Bots blockiert, auch Suchmaschinen | Explizite Allow-Regeln für gewünschte Bots |

Widersprüchliche Einträge | Bot Verhalten unklar | Pro User-Agent einen klaren Block |

Kopierte robots.txt | Fremde Pfade passen nicht | An eigene Struktur anpassen |

Vergessene Subdomains | Ungefilteter Zugriff auf shop. oder blog. | Eigene robots.txt pro Subdomain |

Der Autor empfiehlt: Nutze ein Tool, das diese Fehler automatisch erkennt und in Klartext erklärt.

FAQ: Häufige Fragen zu robots.txt und KI-Crawlern

Reicht es, wenn ich GPTBot blockiere, um meine Inhalte vor KI-Training zu schützen?

Das Blockieren von GPTBot ist ein wichtiger Schritt, aber kein vollständiger Schutz. Andere KI-Betreiber haben eigene Crawler, und bösartige Scraper ignorieren die robots.txt komplett. Ergänze die Blockade um ClaudeBot und PerplexityBot sowie weitere bekannte KI-Bots.

Beeinflusst das Blockieren von GPTBot mein Google-Ranking?

Nein, GPTBot hat nichts mit Googlebot zu tun. Solange du Googlebot nicht blockierst, bleibt dein Google-Ranking unberührt. Die Suchmaschinen Crawler von Google und Bing arbeiten unabhängig von KI-Trainings-Crawlern.

Wie sehe ich im Nachhinein, ob meine Inhalte bereits zum Training genutzt wurden?

Stand 2026 gibt es kaum Transparenz darüber, welche Inhalte in LLMs eingeflossen sind. Du kannst nicht rückwirkend prüfen, ob deine Web-Inhalte verwendet wurden. Die robots.txt wirkt nur für zukünftiges Crawling.

Brauche ich als kleiner Blog überhaupt eine angepasste robots.txt?

Ja, auch kleine Seiten können betroffen sein. Eine einfache, bewusste Konfiguration dauert nur wenige Minuten und gibt dir Kontrolle über die Nutzung deiner Inhalte. Online Shops und Blogs profitieren gleichermaßen von dieser Steuerung.

Was passiert, wenn ich meine robots.txt versehentlich falsch konfiguriere?

Fehler sind meist reversibel. Allerdings können falsche Einstellungen zu temporären Traffic-Einbußen führen, wenn wichtige Suchmaschinen blockiert werden. Teste Änderungen immer direkt im Browser oder nutze ein automatisiertes Prüftool, um Hilfe bei der Validierung zu erhalten.

Call-to-Action: robots.txt und KI-Zugriff automatisch prüfen lassen

Eine bewusste Steuerung von GPTBot, ClaudeBot und PerplexityBot ist heute strategisch wichtig. Manuelles Prüfen funktioniert, kostet aber Zeit – und Fehler passieren schnell. Bot-Management-Lösungen können dabei helfen, schädlichen bot traffic zu identifizieren und zu reduzieren, was die Performance der Website verbessert.

Das kostenlose AEO-Check-Tool analysiert deine aktuelle robots.txt automatisch und zeigt dir:

- Welche KI-Bots aktuell Zugriff auf deine Website haben

- Warnungen bei gefährlichen Blockaden (z.B. wenn Googlebot oder Bingbot gesperrt sind)

- Einfache Handlungsempfehlungen in Klartext – ohne technischen Overkill

Teste jetzt deine Domain und finde heraus, ob du KI-Crawler blockierst, ohne es zu wissen. Kontrolle über KI-Crawler ist heute ein fester Bestandteil einer zeitgemäßen SEO- und AEO-Strategie – und der erste Schritt beginnt mit Vertrauen in deine eigene Konfiguration.